Tesla 系列是 NVIDIA 的专业级/数据中心级 GPU,专为 AI、深度学习、高性能计算、数据分析等大规模并行计算任务设计,它们与面向游戏玩家的 GeForce 系列和面向设计师的 RTX 系列有显著区别。

(图片来源网络,侵删)

核心定位与特点

在对比具体型号前,先理解 Tesla 系列的核心特点:

- ECC 支持:这是与消费级显卡最根本的区别,ECC (Error-Correcting Code) 内存可以检测并纠正单比特错误,防止计算结果因内存位翻转而出错,对需要7x24小时稳定运行的科学计算和AI训练至关重要。

- 超大显存:配备 HBM2 或 HBM2e/3 高带宽内存,容量远超消费级显卡(从24GB到80GB不等),能容纳庞大的数据集和复杂的AI模型。

- NVLink 高速互联:通过 NVLink Bridge 和 NVSwitch 技术,可以实现多GPU之间超高的点对点带宽(远超传统的PCIe总线),极大提升多卡协同训练和计算的效率。

- 优化的计算库与驱动:拥有专门针对计算优化的驱动程序(如 NVIDIA Driver for Linux)和成熟的软件栈(CUDA, cuDNN, TensorRT),提供最佳的性能和稳定性。

- 长生命周期与支持:数据中心和企业级产品,通常有更长的供货周期和长期的技术支持。

主要 Tesla GPU 系列对比

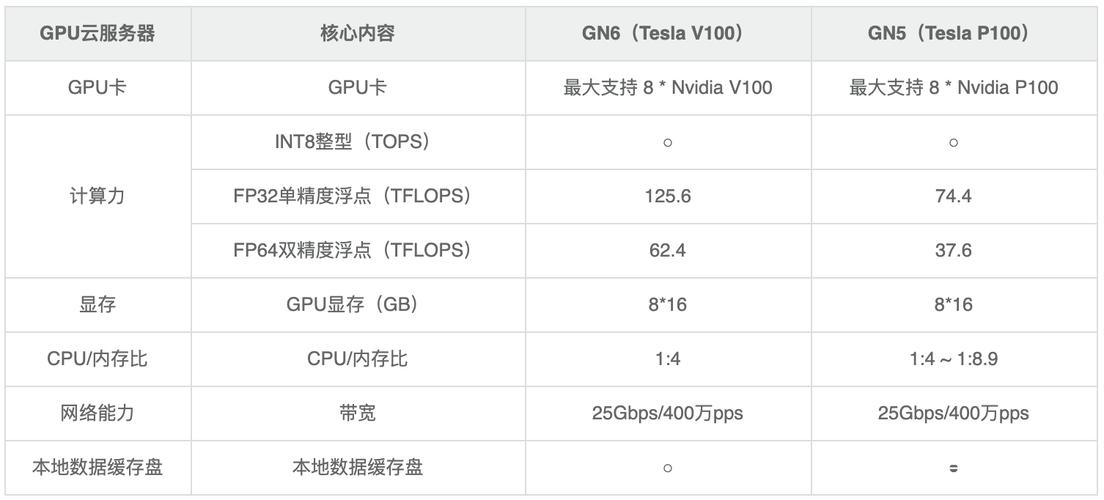

我们将对比几个最具代表性的 Tesla 系列:V100、A100 和 H100,这三者代表了三个不同时代的技术演进。

| 特性 | Tesla V100 (Volta 架构) | Tesla A100 (Ampere 架构) | Tesla H100 (Hopper 架构) |

|---|---|---|---|

| 发布年份 | 2025 | 2025 | 2025 |

| 核心架构 | Volta | Ampere | Hopper |

| 制造工艺 | 12nm FFN (台积电) | 7nm (三星) | 4N (台积电) |

| GPU 显存 | 32GB HBM2 或 16GB HBM2 |

40GB HBM2e 或 80GB HBM2e |

80GB HBM3 或 80GB HBM3 (带有 L2 缓存) |

| 显存带宽 | 900 GB/s | 55 TB/s / 2.0 TB/s | 35 TB/s |

| Tensor Core | 第三代 支持 TF32, FP16, INT8 |

第三代 支持 TF32, FP16, BFLOAT16, INT8, INT4 |

第四代 (SMM) 支持 TF32, FP8, FP16, BFLOAT16, INT8, INT4 |

| FP8 精度 | 不支持 | 不支持 | 支持 (专为 Transformer 引擎优化) |

| Transformer Engine | 不支持 | 不支持 | 支持 (动态使用 FP8 和 FP16,极大提升大语言模型训练/推理性能) |

| NVLink 带宽 | 300 GB/s (双向) | 600 GB/s (双向) | 900 GB/s (双向) |

| PCIe 接口 | PCIe 3.0 x16 | PCIe 4.0 x16 | PCIe 5.0 x16 |

| TFLOPS (FP16/BF16) | ~125 TFLOPS | ~312 TFLOPS | ~989 TFLOPS |

| TFLOPS (FP32) | ~14 TFLOPS | ~19.5 TFLOPS | ~67 TFLOPS |

| 关键创新 | 引入 Tensor Core,奠定AI加速基础 | 多实例GPU (MIG),实现硬件级资源隔离 | Transformer Engine 和 FP8,专为生成式AI设计 |

各系列详细解析

Tesla V100 (Volta 架构)

V100 是 AI 计算的“开山鼻祖”,它首次引入了革命性的 Tensor Core,将深度学习的训练速度提升了数倍,开启了现代 AI 大模型时代。

- 优点:

- 成熟稳定,拥有庞大的用户基础和经过充分验证的软件生态。

- 性能对于许多中等规模的AI模型和科学计算任务依然足够。

- 价格相对较低,是入门级高性能计算的性价比之选。

- 缺点:

- 显存带宽和容量相比新一代产品有明显差距。

- 不支持 BFLOAT16 和 FP8,对最新的 AI 模型优化不足。

- PCIe 3.0 和 NVLink 带宽限制了多卡扩展的效率。

- 适用场景:

- 中小规模的深度学习模型训练。

- 传统的高性能计算任务。

- 作为推理卡,处理延迟要求不高的任务。

Tesla A100 (Ampere 架构)

A100 是 V100 的全面升级,在性能、能效和功能上都有巨大飞跃,是当前数据中心的主力军。

(图片来源网络,侵删)

- 优点:

- 性能翻倍:在 FP16/FP32 计算性能上相比 V100 有显著提升。

- 超大显存:80GB 版本的显存容量,可以训练和运行规模大得多的模型。

- 多实例GPU (MIG):这是革命性的功能,它可以将单个 A100 GPU 在硬件层面分割成最多7个独立的实例,每个实例拥有独立的显存、计算核心和缓存,这极大地提高了 GPU 利用率和安全性,非常适合云服务提供商和需要多租户隔离的场景。

- 支持 BFLOAT16,这对自然语言处理等领域的训练至关重要。

- 缺点:

- 面对生成式AI的爆发式增长,其计算能力(特别是针对 Transformer 架构)开始显现瓶颈。

- 不支持最新的 FP8 精度。

- 适用场景:

- 大规模深度学习模型训练(如 GPT-3 级别)。

- 云计算、数据中心的主流部署。

- 需要 MIG 功能进行多租户隔离的场景。

- 科学计算、数据分析、基因组学等。

Tesla H100 (Hopper 架构)

H100 是专为生成式AI和大型语言模型设计的“终极武器”,它代表了当前 GPU 计算技术的巅峰。

- 优点:

- 专为 AI 优化:Transformer Engine 是 H100 的灵魂,它能智能地在 FP8 和 FP16 之间切换,在保证模型精度的同时,将 LLM 的训练和推理速度提升高达 9 倍。

- FP8 精度:引入了新的 FP8 数据类型,计算密度和吞吐量远超 FP16。

- 性能怪兽:计算性能和显存带宽相比 A100 提升了数倍,是处理万亿参数级别模型的唯一选择。

- 更强的 NVLink 和 PCIe:提供更高的多卡互联和主机通信带宽。

- Confidential Computing:支持安全计算,保护数据在 GPU 内部的处理过程。

- 缺点:

- 价格极其昂贵。

- 功耗巨大,对散热和供电要求极高。

- 软件生态仍在快速发展中。

- 适用场景:

- 生成式AI:GPT、LLaMA、Stable Diffusion 等超大规模模型的训练和推理。

- 前沿科学计算:需要极致算力的物理模拟、气候预测等。

- 大型语言模型即服务。

如何选择?一张图看懂

| 如果你的需求是... | 推荐选择 | 理由 |

|---|---|---|

| 入门级 HPC 或 AI 研究,预算有限 | Tesla V100 | 性价比高,生态成熟,足以完成许多任务。 |

| 主流数据中心部署,训练大模型,需要多租户隔离 | Tesla A100 | 性能、显存、MIG 功能的完美平衡,当前市场主力。 |

| 训练或部署万亿参数级的生成式AI模型 | Tesla H100 | 无可匹敌的性能,Transformer Engine 专为 LLM 优化,是未来的标准。 |

| 已有 V100,想升级多卡系统 | Tesla A100 | NVLink 带宽翻倍,多卡扩展效率更高。 |

| 已有 A100,想应对未来AI浪潮 | Tesla H100 | FP8 和 Transformer Engine 带来的代际优势,能让你在竞争中领先。 |

Tesla 系列的演进史,就是一部 AI 和 HPC 算力需求的增长史。

- V100 定义了AI加速的标准。

- A100 引入了多实例和超大显存,成为数据中心的基石。

- H100 则是专为生成式AI而生的“核武器”,开启了 AI 新纪元。

选择哪款 GPU,完全取决于你的具体应用场景、数据集规模、模型复杂度和预算,对于追求极致性能和面向未来的用户,H100 是不二之选;对于绝大多数企业和研究机构,A100 依然是当下最稳妥、最具性价比的选择。

(图片来源网络,侵删)